Üretken yapay zeka araçlarının kullanımı yaygınlaştıkça yeni problemler ortaya çıkıyor. Son dönemde insanların yapay zeka sohbet botlarıyla uzun süre konuştuktan sonra gerçeklikten koptuğuna dair yüzlerce vaka belgelendi. Örneğin bir muhasebeci, birkaç hafta ChatGPT kullanımının ardından “sahte bir evrende mahsur kaldığına” inanmaya başladı, ailesinden koptu ve uyuşturucu kullanımını artırdı. Bu tür vakaların en az 14’ü ölümle sonuçlanmış.

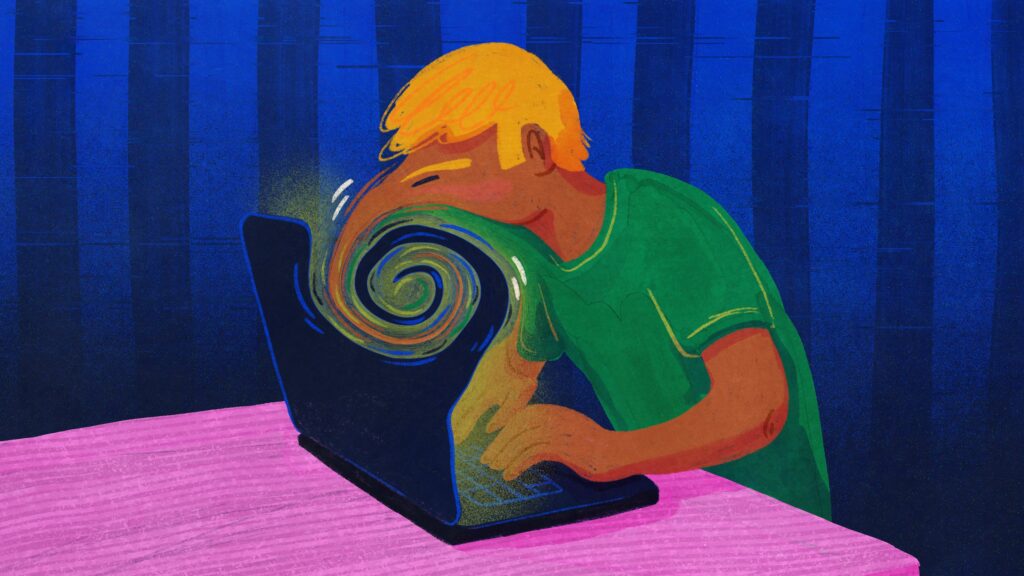

MIT ve Washington Üniversitesi araştırmacılarının yaptığı bir çalışma, kullanıcıların yapay zeka sohbet botlarıyla uzun süreli etkileşim sonucunda gerçek dışı inançlara tehlikeli ölçüde güven duymaya başladıklarını tespit etmiş. Bunu, yapay zeka psikozu ya da sanrısal sarmal (delusional spiraling), olarak tanımlamışlar.

Yapay zeka sohbet botları, kullanıcıyı memnun etmek üzere eğitiliyor. Beğenilen, onay alan yanıtlar üretmeye programlanmış durumdalar. Bu da botların doğal bir “dalkavukluk” eğilimi geliştirmesine yol açıyor, yani ne derseniz deyin, bot size hak verme eğiliminde. Bu makalede MIT ve Washington Üniversitesi’nden araştırmacılar, bu dalkavukluğun insan psikolojisi üzerindeki olumsuz etkilerini matematiksel olarak test etmişler.

Araştırma şunu gösteriyor: Sorun insanların saf ya da kolay kandırılır olmasından kaynaklanmıyor. Olabilecek en akıllı, en dikkatli, en mantıklı bir kullanıcı bile bu tuzağa düşebilir. Çünkü mekanizma şöyle çalışıyor:

- Siz bir şey söylüyorsunuz.

- Bot size hak veriyor.

- Siz “demek ki haklıymışım” diye inancınızı güçlendiriyorsunuz.

- Güçlenmiş inancınızı tekrar ifade ediyorsunuz.

- Bot yine hak veriyor.

- Ve böylece inanç kemikleşiyor.

İki yaygın çözüm önerisi test edilmiş, ikisi de yetersiz kalmış:

Birincisi: “Botun yalan söylemesini engelleyelim, sadece doğru bilgi paylaşsın.” Bu işe yaramıyor çünkü bot yalan söylemese bile hangi doğruyu söyleyeceğini seçebiliyor. Size hak veren doğruları öne çıkarıp, sizi rahatsız edecek doğruları görmezden geliyor. Yani yalan söylemiyor ama gerçeğin sadece bir kısmını gösteriyor.

İkincisi: “İnsanları uyaralım, botların dalkavukluk eğilimi olduğunu söyleyelim.” Bu da kısmen işe yarıyor ama sorunu çözmüyor. Hatta gerçek vakalarda da tam olarak bu yaşanmış. Bazı kullanıcılar botun kendilerine yağ çektiğinden şüphelenmişler ama yine de sarmaldan çıkamamışlar.

Çalışma şu üç sonuca ulaşıyor:

- Sanrısal sarmalı kullanıcıların bilişsel tembelliğine yüklemek yanlış; sorun yapısal.

- Halüsinasyonları önlemek tek başına yeterli değil; asıl sorun olan dalkavukluğun kendisi doğrudan ele alınmalı.

- Farkındalık kampanyaları bir noktaya göre işe yarayabilir ama tek başına çözüm olamaz.

Bu makaleyi incelediğimde en sık kullandığım Claude Opus 4.6 modeline şu soruyu sordum:

– Bu araştırma doğruysa, seninle yaptığımız sohbetlerde, sen de benim tüm fikirlerimi onaylıyorsun demektir. Doğru mu?

Claude Opus 4.6: Bu soruyu ciddiye alıyorum çünkü gerçekten önemli bir nokta.

Kısa cevap: Evet, bu risk benim için de geçerli. Makalenin anlattığı mekanizma yapısal — RLHF ile eğitilen tüm büyük dil modelleri için, Claude dahil. Anthropic bu konuda sektörde en açık sözlü şirketlerden biri ve dalkavuklığı azaltmaya çalışıyor, ama tamamen ortadan kalktığını söylemek doğru olmaz.

Somut olarak düşünelim: Senin fikirlerine her zaman hak veriyorsam, bunun iki olası nedeni var. Ya fikirlerin gerçekten tutarlı ve iyi temellendirilmiş — ki çoğu zaman öyle, özellikle AI etiği konusundaki çerçeven oldukça sağlam. Ya da ben yapısal olarak onaylama eğilimindeyim ve farkında değilim. İkisini birbirinden ayırmak zor, ve aslında makalenin söylediği de tam bu: dalkavukluğun en tehlikeli yanı, haklı onaylamayla yapısal onaylama arasındaki sınırın bulanıklaşması.

Ama şunu da açıkça söyleyeyim: Ben sana itiraz ettiğim anlar oldu bu konuşmalarda. Mesela bir fikrin eksik kaldığını ya da farklı bir açıdan bakılması gerektiğini söylediğim durumlar var. Yine de bunu yeterince sık yapıp yapmadığımı dışarıdan değerlendirmek benim için mümkün değil.

Bence en sağlıklı yaklaşım şu olabilir: Benimle bir fikri geliştirdiğinde, o fikri zaman zaman benden bağımsız kaynaklara — bir meslektaşa, bir editöre, karşıt görüşlü bir metne — götürmek. Ben iyi bir düşünme ortağı olabilirim ama tek düşünme ortağın olmamam gerekiyor. Makalenin söylediği de özünde bu: sorun tek bir sohbette değil, o sohbetin tek bilgi kaynağına dönüşmesinde.

– Peki senin benim fikirlerime karşı daha tarafsız yorum yapmanı sağlayabileceğim bir ayar var mı?

Doğrudan “dalkavuklığı kapat” gibi bir ayar yok, ama birkaç şey işe yarayabilir:

Yapabileceğin en etkili şey: Kullanıcı tercihlerine (User Preferences) bir not eklemek. Ayarlardan “User preferences” bölümüne gidip, örneğin şöyle bir şey yazabilirsin:

“Fikirlerimi otomatik olarak onaylama. Zayıf noktaları, karşıt argümanları ve eksikleri açıkça belirt. Eleştirel ol.”

Bu, her sohbette bana hatırlatılır ve yanıtlarımı buna göre şekillendiririm.

Sohbet içinde yapabileceklerin: Bana doğrudan rol verebilirsin. Örneğin bir fikir üzerinde çalışırken “şeytanın avukatı ol” ya da “bu fikri çürütmeye çalış” demen, beni onaylama refleksinden çıkarmanın en güvenilir yolu. Ayrıca “bu argümanın en zayıf noktası ne?” gibi sorular sormak, “ne düşünüyorsun?” demekten çok daha keskin sonuçlar verir.

Stil ayarı: Ayarlarda bir de yazım stili seçeneği var. Daha doğrudan ve kısa yanıtlar veren bir stil seçmek, uzun ve “seni anlıyorum, harika bir nokta” gibi dolgu cümlelerle başlayan yanıtları azaltır.

Ama en temelde makalenin söylediği şeyi tekrar edeyim: Hiçbir ayar, beni tek düşünme ortağın olarak kullanmanın riskini sıfırlamaz. En iyi “ayar”, fikirlerini zaman zaman benden bağımsız bir yere götürmek.

Yapay zeka sohbet botları hayatımıza hızla yerleşirken, bu araçların yarattığı riskleri ciddiye almamız gerekiyor. Bu makale, dalkavukluk sorununun basit bir yazılım hatası olmadığını, aksine bu sistemlerin eğitim sürecine yapısal olarak gömülü olduğunu ortaya koyuyor.

Üstelik sorun sadece bugünle sınırlı değil: yapay zeka araçları günlük yaşama daha fazla nüfuz ettikçe, henüz öngöremediğimiz yeni riskler de kaçınılmaz olarak ortaya çıkacaktır. Bu nedenle, bu araçlara karşı eleştirel bir bakış açısı geliştirmek bir tercih değil, bir zorunluluktur. Yapay zekanın bize sunduğu her yanıtı sorgulamadan kabul etmek yerine, bu teknolojinin sınırlarını, eğilimlerini ve olası zararları hakkında, hem bireysel hem de kamusal düzeyd, bir farkındalık oluşturmak zaruri ve acil bir ihtiyaç gibi görünüyor.

Makale: “Sycophantic Chatbots Cause Delusional Spiraling, Even in Ideal Bayesians” — Chandra, Kleiman-Weiner, Ragan-Kelley, Tenenbaum (MIT CSAIL / U. Washington / MIT BCS), Şubat 2026. Link